引言

在天气预报业务中,临近预报通常是指某一区域0~2 h内短时强降水、冰雹、雷暴大风、龙卷和雷电等强对流天气预报(俞小鼎等,2012;俞小鼎和郑永光,2020)。对流天气通常与中小尺度天气系统关系密切,其突发性强、发展迅速、极易成灾。武汉是中国中部最大的城市,这里集中了湖北省一半以上的人口和六成以上的GDP,由于地处东亚副热带季风区,强对流天气频发,极易造成严重的人员伤亡和经济损失,如2021年5月10日受强飑线影响,武汉中心城区普降暴雨到大暴雨,全市大部地区伴有8~11级阵风,强阵风导致两名高空作业人员遇难,还造成武汉高铁站候车大厅雨水渗漏,多条铁路延误;仅仅3 d之后,14日20:39(北京时)武汉蔡甸奓山片区和经开区军山片区突发龙卷风,造成10人死亡、230人受伤,直接经济损失约3.01亿元人民币。可见,对流天气临近预报对气象防灾减灾意义重大。

目前,业务上的临近预报主要有两类:快速更新循环的中尺度数值天气预报和基于雷达回波的外推预报(程丛兰等,2013)。中尺度数值模式预报受模式起转过程和资料同化时效等因素限制,在最初的几个小时内准确率和精细化程度都难以满足业务需求(郭瀚阳等,2019;吴剑坤等,2019),故而业务上对流天气临近预报仍以基于雷达回波的外推预报为主,主要包括单体质心法、交叉相关法和光流法。单体质心法是通过计算雷达连续体扫中对流单体的回波参数,识别和跟踪对流单体或对流单体群而获取其移动和演变信息,然后进行外推预报,由于计算量较大,仅适用于强对流风暴(Dixon and Wiener,1993;徐月飞等,2011)。交叉相关法是通过计算相邻时刻反射率因子超过一定阈值的回波区域的最大空间优化相关系数,来追踪和外推回波。该方法可以有效追踪缓慢变化的层状云降水系统,但对于快速增长或消散的强对流预报效果不理想(Rinehart and Garvey,1978;徐亚钦等,2011)。光流法是通过计算雷达回波的光流场得到回波的运动矢量场,再基于该运动矢量场对雷达回波进行外推预报。光流法可以较为准确地捕获雷暴的整体运动趋势,显著提升雷暴临近预报的准确率,但对于热带降水系统尤其是台风系统,光流法预报效果不如交叉相关法,且对于快速移动的回波预报误差较大(张蕾等,2014;曹春燕等,2015)。随着外推方法的不断改进,基于雷达回波外推的临近预报效果得到了较大提升,但由于没有考虑风暴的动力学和热力学等因素影响,针对对流系统生消和发展的预报还存在较大不足,致使外推预报误差仍较大。

近年来,以机器学习为代表的人工智能技术在图像识别和视频领域取得了突破性进展,因其在解决复杂问题和非线性建模等方面的突出表现(许小峰,2018;陈训来等,2021),人工智能技术被引入雷达回波临近预报中(朱文刚等,2020;孟辉等,2020)。研究表明,深度学习模型不仅提升了雷达回波临近预报效果,对中等强度回波预报较好,且对回波强度变化也具有一定预报能力(陈元昭等,2019;陈训来等,2021)。雷达回波的本质是对流风暴云水性质的综合反映,其生命史和运动特征非常复杂,而湖北武汉地处青藏高原东侧的副热带季风区,受东、西风带系统影响,加之东北部大别山、东南部幕阜山及众多湖泊、密布河网,独特的气候背景、地理位置、地形和地貌特征使得该区域对流风暴的发生、发展和移动有其独特性(崔春光等,2002)。因此,本文利用计算成本较低且内部结构差异较大的MIM、PredRNN++、CrevNet和PhyDNet 4种深度学习模型,在武汉地区开展人工智能技术应用研究,并以半拉格朗日光流法(简称“光流法”)做对比,详细检验和评估这些模型或方法对2021年汛期(5月1日至9月30日)武汉地区雷达回波的临近预报效果,定量探讨各深度学习模型的预报能力,以期找到适合的模型或方法满足武汉地区雷达回波的临近预报需求。

1 资料

所用资料包括2015年1月1日至2021年9月30日湖北省武汉市19个观测质量较好且分布较均匀的气象站(5个国家气象观测站和14个区域自动气象观测站)08:00—08:00(北京时,下同)逐日和逐小时降水观测资料、武汉雷达站组合反射率因子(观测范围为112.545°E—115.745°E、28.917°N—32.117°N,空间分辨率为1 km×1 km,时间分辨率为6 min)、湖北东部地区二维闪电观测资料以及武汉市行政边界数据[由湖北省地理信息公共服务平台提供,审图号为鄂S(2022)005号]。其中,雷达回波资料进行了孤立噪声过滤、地物杂波和超折射回波抑制处理(Steiner and Smith,2002)。

2 方法

2.1 深度学习模型简介

雷达回波临近预报的本质是对时空序列的预测,在深度学习方面可分为以卷积神经网络(convolutional neural network, CNN)和循环神经网络(recurrent neural network, RNN)为基础的两大类,以CNN为基础的模型侧重于对空间特征的提取,而以RNN为基础的模型则偏重于对时间特征的捕捉,且存在梯度消失的问题。为了兼顾模型提取空间特征和时间信息的均衡性,大多数深度学习模型将CNN和RNN结合使用,本文采用的4种模型亦是如此。

2.1.1 PredRNN++模型

Shi等(2015)将RNN中传统的LSTM(Long Short-Term Memory)全连接层改为卷积层,提出了ConvLSTM模型,该模型将LSTM或GRU(Gate Recurrent Unit)中的记忆模块改造成CNN结构,增强了模型对空间特征的提取能力。Wang等(2017)在ConvLSTM模型基础上,将可记忆的单元放置在模型的堆叠结构中,提出了PredRNN模型,同时为缓解该模型梯度易消失的问题及提高对短时非线性时空特征的提取能力,引入了GHU(Gradient Highway Unit),使得梯度在第一层和第二层之间高速传递,有效抑制了梯度消失,最终提出了PredRNN++模型(Wang et al.,2018)(https://github.com/Yunbo426/predrnn-pp)。

2.1.2 MIM模型

为解决PredRNN中LSTM遗忘门的饱和问题,Wang等(2019)首次将图片信息分为平稳信息和非平稳信息两部分,提出了MIM(Memory in Memory)模型(https://github.com/Yunbo426/MIM)。该模型分两次对图片信息进行提取,首先由MIM-N结构提取非平稳信息,而后传递给MIM-S;MIM-S利用门控选择记忆或忘记一定的非平稳信息,并通过多层模块之间相互的差分运算,使得非平稳信息缓慢降低,从而提取各种高阶的平稳信息;最终将提取的平稳信息和非平稳信息相结合,进行输出与预测。

2.1.3 CrevNet模型

CrevNet模型(Yu et al.,2020)(https://github.com/rrxi/CrevNet),是一种全新的嵌套了三维卷积模块的双向可逆自编码结构,它在一系列正向和反向计算过程中使得输入与特征之间建立一对一的双向映射关系,这种关系理论上保证了在特征提取过程中不丢失信息,从而保留更多信息进行预测,明显提高了预测图片的清晰度。此外,该模型的内存和计算开销都较小,对硬件要求不高,易于训练和调试。

2.1.4 PhyDNet模型

PhyDNet模型(Vincet and Nicolas,2020)(https://github.com/vincent-leguen/PhyDNet),参考了MIM模型的基本假设,将图片信息分为已知的物理过程和未知因素(包括生消、发展等)两部分,然后利用Phycell结构约束模型,以ConvLSTM为主要内核提取未知因素,并以卷积过程模拟偏导,最后将学习到的物理过程信息和未知因素结合进行预测。

2.2 半拉格朗日光流法简介

2.3 检验方法

为客观定量地评估各深度学习模型的预报能力,以实况回波图像为基础,先将实况回波图像和预报回波图像格点化成单独的像素点,再逐个检验像素点的预报准确率。采用均方误差(Mean Square Error, MSE)表征预报回波图像与实况回波图像的强度误差,以结构相似性指数(Structural Similarity Index Measurement, SSIM)(Wang et al.,2004)衡量预报回波图像与实况回波图像的相似度。MSE和SSIM的计算公式如下:

式中:

此外,采用临界成功指数(Critical Success Index, CSI)、命中率(Probability of Detection, POD)和空报率(False Alarm Rate, FAR)等指标对预报结果进行量化评估,CSI、POD和FAR的计算公式如下:

式中:NA、NB和NC分别表示某一回波图像内预报正确的像素点数、空报的像素点数和漏报的像素点数。判别规则如下:若某一像素点的预报回波强度与实况回波强度均大于或等于K,则记该像素点预报正确(NA);若某一像素点的预报回波强度大于或等于K,而实况回波强度小于K,则记该像素点为空报(NB);若某一像素点的预报回波强度小于K,而实况回波强度大于或等于K,则记该像素点为漏报(NC)。其中,K为雷达回波阈值(本文分别取10、20、30和40 dBZ)。

2.4 模型训练

为尽可能增加模型训练的样本数,使模型能够充分学习到不同类型的回波特征,同时降低样本严重失调带来的不利影响,首先以站点为基础,选取研究时段内任一站点日降水量大于或等于10.0 mm、小时降水量大于或等于0.6 mm,且组合反射率因子连续3 h不间断的雷达回波作为1个样本(若有重叠则算为1个样本),并对其进行切片,得到实况输入和预报输出分别为连续的10张、20张回波图像,共计7 132个样本;然后,基于上述训练样本,以MSE为损失函数,分别对PredRNN++、MIM、CrevNet和PhyDNet 4种深度学习模型进行训练和超参数调整,得到各自的预报模型。

2.5 检验样本选取

为定量化检验各模型在实际业务工作中的预报能力,2021年汛期将上述预报模型在武汉市气象台进行业务试验,根据实时的前10张回波图像,滚动提供0~2 h内时间分辨率为6 min的20张预报回波图像(每组20张预报回波图像称为1个预报样本),理论上可获得36 710个预报样本,除去雷达维修和机械故障时段,实际得到35 713个预报样本(占比97.3%)。在实际天气过程中,降水并非时刻发生,在无降水时间雷达探测到的大多是晴空回波或地物回波,对此类预报样本进行检验评估的天气学意义非常有限。为统一定量化选取有预报价值的检验样本,首先定义了武汉市降水强度指数

式中:

表1 2021年汛期武汉市不同类型降水过程的降水强度和面积划分标准

Tab.1

| 降水过程分类 | PI/mm | PA/% |

|---|---|---|

| 一般区域性过程 | 5.0~24.9 | ≥70 |

| 较强区域性过程 | 25.0~49.9 | ≥70 |

| 强区域性过程 | ≥50.0 | ≥70 |

| 局地一般对流性过程 | 5.0~15.0 | ≤20 |

表2 2021年汛期武汉市各降水过程主要发生时段及其PA和PI

Tab.2

| 降水类型 | 检验样本数/个 | 过程起止时间 | PI/mm | PA/% |

|---|---|---|---|---|

| 一般区域性降水过程 | 2 441 | 5月3日08:00至4日02:00 | 22.7 | 95.8 |

| 5月13日09:00至14日02:00 | 15.7 | 92.6 | ||

| 5月22日10:00至23日08:00 | 22.2 | 95.8 | ||

| 5月26日05:00—08:00 | 11.9 | 94.7 | ||

| 5月26日08:00—16:00 | 22.4 | 95.8 | ||

| 6月26日14:00至27日08:00 | 17.9 | 94.7 | ||

| 6月17日08:00—11:00、18日03:00—08:00 | 7.8 | 93.2 | ||

| 6月18日08:00—11:00、19日00:00—08:00 | 23.3 | 93.2 | ||

| 6月19日08:00至20日08:00 | 7.9 | 96.8 | ||

| 6月26日14:00至27日08:00 | 18.5 | 93.7 | ||

| 7月2日08:00至3日04:00 | 17.8 | 97.9 | ||

| 7月5日08:00至6日08:00 | 19.4 | 98.9 | ||

| 7月16日20:00至17日08:00 | 17.8 | 93.1 | ||

| 7月17日08:00—18:00 | 16.2 | 97.4 | ||

| 7月19日08:00—20:00 | 10.4 | 87.8 | ||

| 8月10日21:00至11日08:00 | 20.3 | 95.8 | ||

| 8月20日11:00至21日02:00 | 20.6 | 96.8 | ||

| 8月24日08:00—17:00 | 16.6 | 97.4 | ||

| 较强区域性降水过程 | 1 537 | 5月10日11:00至11日05:00 | 48.3 | 94.7 |

| 7月1日08:00至2日08:00 | 36.6 | 98.4 | ||

| 7月18日08:00至19日08:00 | 31.6 | 96.3 | ||

| 8月9日08:00至10日08:00 | 40.7 | 96.7 | ||

| 8月11日08:00至12日08:00 | 26.8 | 97.4 | ||

| 8月13日08:00—18:00 | 38.1 | 97.4 | ||

| 9月19日14:00至20日05:00 | 49.6 | 95.8 | ||

| 强区域性降水过程 | 563 | 5月14日08:00至15日08:00 | 50.7 | 93.6 |

| 6月27日08:00—20:00 | 51.9 | 80.0 | ||

| 8月23日21:00至24日08:00 | 74.3 | 98.4 | ||

| 局地一般对流性降水过程 | 1 260 | 7月26日17:00—19:00 | 5.5 | 12.0 |

| 7月27日16:00—19:00 | 8.5 | 18.0 | ||

| 7月28日12:00—17:00 | 6.1 | 17.3 | ||

| 8月2日13:00—17:00 | 7.3 | 7.2 | ||

| 8月3日12:00—14:00 | 8.9 | 16.9 | ||

| 8月4日16:00—21:00 | 6.0 | 10.0 | ||

| 8月5日14:00—19:00 | 6.2 | 8.8 |

3 结果检验

3.1 整体检验评估

为满足户外重大活动气象保障临近预报精细化服务需求,以10 dBZ为回波强度阈值对5 801个检验样本(表2)得分进行平均。从表3可以看到,MIM模型的MSE最小为20.47 dBZ2,CrevNet模型的MSE最大为24.68 dBZ2;各算法的SSIM均较高,MIM和PredRNN++模型最高达0.74;MIM模型的POD最高为0.60,CrevNet模型最低为0.48;所有深度学习模型的FAR均低于光流法(0.35),相较于光流法降低8.6%~31.4%,PhyDNet模型最低为0.24;除CrevNet模型外,其余3种深度学习模型的CSI均高于光流法,相较于光流法提升2.2%~13.3%,MIM模型因最高的POD和较低的FAR,其CSI最高为0.51。

表3 2021年汛期4种深度学习模型和光流法的平均得分

Tab.3

| 算法 | MSE/dBZ2 | SSIM | POD | FAR | CSI |

|---|---|---|---|---|---|

| CrevNet | 24.68 | 0.67 | 0.48 | 0.32 | 0.39 |

| MIM | 20.47 | 0.74 | 0.60 | 0.25 | 0.51 |

| PhyDNet | 22.33 | 0.72 | 0.52 | 0.25 | 0.46 |

| PredRNN++ | 20.72 | 0.74 | 0.57 | 0.24 | 0.50 |

| 光流法 | 24.05 | 0.71 | 0.58 | 0.35 | 0.45 |

由于各深度学习模型都采用相同的输入和输出长度、损失函数及初始学习率,上述整体评分的差异可能更多来源于各模型结构的不同,具体言之:MIM模型由MIM-N和MIM-S两部分组成,首先由MIM-N提取局部特征后传递给MIM-S,再由MIM-S提取整体特征,因此该模型损失的信息最少,对于整体回波形状的学习能力较强,故MSE最小、POD和SSIM最高;PredRNN++模型引入了GHU,可以有效抑制梯度消失的问题,使其能够在更深层的网络中传递信息,从而学习到更多的回波移动和发展规律,故SSIM并列最高、FAR最低;CrevNet模型采用双向可逆自编码器结构,信息保留能力较强,但因采取了预报回波图像和实况回波图像相结合的策略,导致预报回波位置误差较其他模型大,故MSE最大、POD最低。

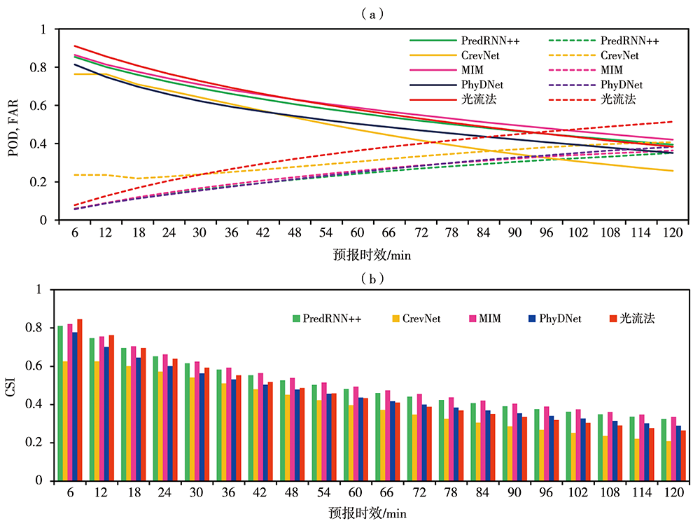

从POD和FAR随时间演变[图1(a)]看出,除CrevNet模型的POD在预报的前12 min基本不变外,其余深度学习模型和光流法的POD均随预报时效延长缓慢降低,光流法的POD在预报的6~48 min(间隔6 min,下同)内最高,MIM模型次之,PredRNN++模型第三,PhyDNet和CrevNet模型相近较低,而在54~120 min内MIM模型的POD最高,光流法次之,CrevNet模型最低;CrevNet模型的FAR在预报的前30 min基本不变,其余深度学习模型和光流法的FAR均随预报时效延长快速升高,30 min后所有模型的FAR均低于光流法,且随着预报时效的进一步延长,光流法的FAR持续上升,而深度学习模型的FAR则趋于平稳,差距不断增大。以MIM模型和光流法为例,预报60 min的FAR分别为0.26和0.38,至120 min分别增至0.36和0.51,两者的差距由0.12增至0.15。从图1(b)看出,预报的前12 min内光流法因较高的POD和较低的FAR,故而CSI最高;之后,随着预报时效的增加FAR快速升高,致使在18、24、60 min CSI依次开始低于MIM、PredRNN++和PhyDNet模型,而MIM模型在预报的18~120 min CSI均最高。

图1

图1

2021年汛期4种深度学习模型和光流法的平均POD(实线)、FAR(虚线)(a)和CSI(b)随时间演变

Fig.1

The time evolution of average POD (solid lines) and FAR (dashed lines)(a) and CSI (b) of four deep learning models and optical flow method in flood season of 2021

另外,不同强度回波的检验结果(表4)显示:随着回波强度增加,各深度学习模型与光流法的CSI和POD都迅速降低,而FAR却表现出不同变化规律,光流法持续增大,深度模型则呈先升后降的变化特征。总体来看,对于20 dBZ及以上回波,MIM模型因较高的POD和较低的FAR,预报效果最佳;对于30 dBZ及以上回波,MIM模型和光流法的预报效果均最佳;对于40 dBZ及以上回波,光流法的POD最高,预报效果最佳;PhyDNet模型对所有回波预报的FAR均最低。

表4 2021年汛期4种深度学习模型和光流法对不同强度回波预报的平均得分

Tab.4

| 算法 | CSI | POD | FAR | ||||||

|---|---|---|---|---|---|---|---|---|---|

| 20 dBZ | 30 dBZ | 40 dBZ | 20 dBZ | 30 dBZ | 40 dBZ | 20 dBZ | 30 dBZ | 40 dBZ | |

| 光流法 | 0.43 | 0.28 | 0.08 | 0.55 | 0.39 | 0.14 | 0.36 | 0.55 | 0.72 |

| MIM | 0.49 | 0.28 | 0.06 | 0.58 | 0.34 | 0.07 | 0.28 | 0.31 | 0.14 |

| CrevNet | 0.38 | 0.24 | 0.05 | 0.47 | 0.33 | 0.08 | 0.35 | 0.52 | 0.51 |

| PhyDNet | 0.42 | 0.21 | 0.04 | 0.49 | 0.32 | 0.05 | 0.25 | 0.26 | 0.09 |

| PredRNN++ | 0.47 | 0.25 | 0.05 | 0.55 | 0.30 | 0.06 | 0.26 | 0.27 | 0.10 |

3.2 不同强度降水过程的检验评估

从不同强度降水过程的检验结果(表5)看出,对于较强区域性降水过程和局地一般对流性降水过程,光流法的POD最高,而一般区域性降水过程和强区域性降水过程则是MIM模型的POD最高;PredRNN++模型在所有类型降水过程中FAR均最低,而MIM在所有类型降水过程中CSI均最高。

表5 2021年汛期光流法与4种深度学习模型对不同强度降水过程回波预报的平均得分

Tab.5

| 降水类型 | 光流法 | MIM | CrevNet | PhyDNet | PredRNN++ | ||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| POD | FAR | CSI | POD | FAR | CSI | POD | FAR | CSI | POD | FAR | CSI | POD | FAR | CSI | |

| 一般区域性降水过程 | 0.59 | 0.35 | 0.46 | 0.64 | 0.24 | 0.52 | 0.48 | 0.33 | 0.40 | 0.53 | 0.25 | 0.47 | 0.58 | 0.23 | 0.51 |

| 较强区域性降水过程 | 0.60 | 0.35 | 0.46 | 0.58 | 0.24 | 0.50 | 0.47 | 0.28 | 0.40 | 0.49 | 0.24 | 0.44 | 0.56 | 0.23 | 0.49 |

| 强区域性降水过程 | 0.60 | 0.30 | 0.50 | 0.69 | 0.23 | 0.59 | 0.59 | 0.29 | 0.49 | 0.63 | 0.21 | 0.55 | 0.65 | 0.20 | 0.57 |

| 局地一般对流性降水过程 | 0.48 | 0.54 | 0.31 | 0.40 | 0.37 | 0.32 | 0.28 | 0.41 | 0.22 | 0.29 | 0.38 | 0.24 | 0.38 | 0.36 | 0.31 |

对于区域性降水过程,随着降水强度的增加,深度学习模型的预报能力表现出先略有降低后明显升高的变化趋势,表明深度学习模型对强降水过程有较好的预报能力,而光流法对降水强度变化的敏感性较弱,预报性能随降水强度变化较小。其中,对于强区域性降水过程,深度学习模型(CrevNet除外)的CSI相比于光流法增幅最大,达10.0%~18.0%;对于局地一般对流性降水过程,所有深度学习模型的预报能力均大幅降低,所有模型的POD均低于光流法,但光流法的FAR仍超过所有深度学习模型。

3.3 重大天气过程的检验评估

2021年8月23日夜间至24日白天,受中低层切变线影响,武汉市普降大到暴雨,部分地区出现大暴雨,大暴雨区主要位于武汉市中南部,降水主要集中在23日21:00至24日15:00,最大累积雨量158.1 mm,最大小时雨量62.1 mm。从8月23—24日武汉站新一代多普勒天气雷达回波监测(图略)来看,此次暴雨天气过程经历了开始、维持和结束3个阶段,分别选取23日22:00、24日02:00和14:00作为上述3个阶段的起报时次,详细分析和探讨各深度学习模型和光流法对雷达回波发展趋势和移动特征的预报能力。

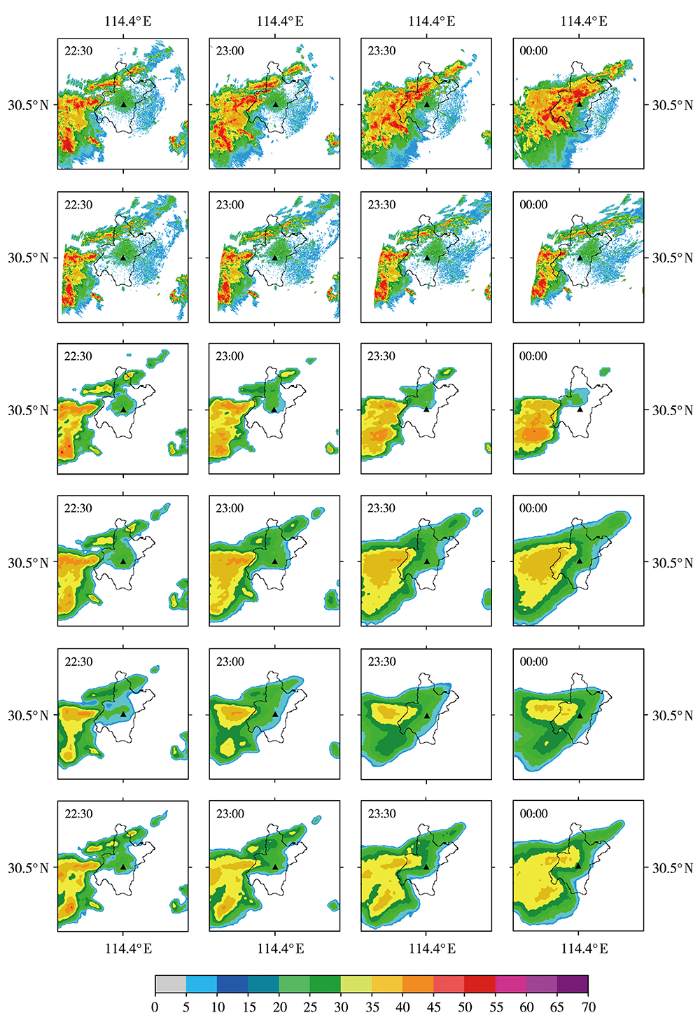

3.3.1 开始阶段

8月23日夜间实况雷达回波显示,23日22:00武汉市西北部存在一条WSW—ENE向的窄带状回波,西部存在45 dBZ以上的片状强回波(图略);之后,片状强回波持续东移且不断发展,范围明显增大,但强度变化不大,同时西北部带状回波也缓慢东移,至23:30两块回波在汉口城区附近合并成NE—SW向的片状回波(图2)。

图2

图2

2021年8月23日22:30至24日00:00雷达回波实况和4种深度学习模型及光流法预报回波对比(单位:dBZ)

(从上至下依次为实况回波、光流法及CrevNet、MIM、PhyDNet、PredRNN++模式预报回波,黑色三角为武汉雷达站,黑色线包围区域为武汉市。下同)

Fig.2

The comparison of radar echo forecasted by four deep learning models and optical flow method with the observation from 22:30 on 23 August to 00:00 on 24 August, 2021 (Unit: dBZ)

(From top to bottom, it is the observed radar echo and radar echo forecasted by optical flow method and deep learning models of CrevNet, MIM, PhyDNet and PredRNN++ in turns, the black triangle is for the Wuhan radar station, the area enclosed by black line is for the Wuhan City. the same as below)

对比预报结果(图2)发现:光流法对回波形态的预报效果较差,尤其对后期从西侧进入武汉及其周边地区的回波缺乏预报能力,导致预报的回波范围严重偏小、形状偏差较大;而深度学习模型均正确预报出后期移入武汉及西部地区的新生回波,因而各模型CSI(表6)均超过光流法,提升幅度为25.0%~47.9%,但各模型之间对强回波面积、形状和位置的把握差异较大。具体表现为:PhyDNet模型预报的强回波面积最小,CrevNet模型预报的强回波位置最偏西,MIM和PredRNN++模型预报的强回波面积、形状和位置最接近实况。另外,从回波强度上看,所有深度学习模型预报的回波强度较实况都明显偏弱,其中CrevNet模型预报的强度最强,最接近实况。

表6 2021年8月23—24日3个起报时刻4种深度学习模型和光流法回波预报的CSI评分

Tab. 6

| 起报时刻 | 光流法 | MIM | CrevNet | PhyDNet | PredRNN++ |

|---|---|---|---|---|---|

| 23日22:00 | 0.48 | 0.71 | 0.67 | 0.60 | 0.69 |

| 24日02:00 | 0.74 | 0.80 | 0.75 | 0.79 | 0.82 |

| 24日14:00 | 0.59 | 0.65 | 0.56 | 0.64 | 0.61 |

造成深度学习模型预报回波偏弱的主要原因:一方面,各模型首先都对回波图像进行离散格点化,然后再利用各自的网络结构进行空间特征提取,这个过程中不可避免地存在信息损失,且预报时效越长,信息损失越严重,从而导致预报回波强度较实况偏弱,回波的细节特征不明显;另一方面,还可能与损失函数的设定有关,以均方误差为损失函数平均了整幅图像的误差,使得预报回波强度趋于平均,导致回波强度偏弱,在视觉上产生逐渐“模糊化”的过程,因而损失了大量的细节特征(周康辉等,2021)。

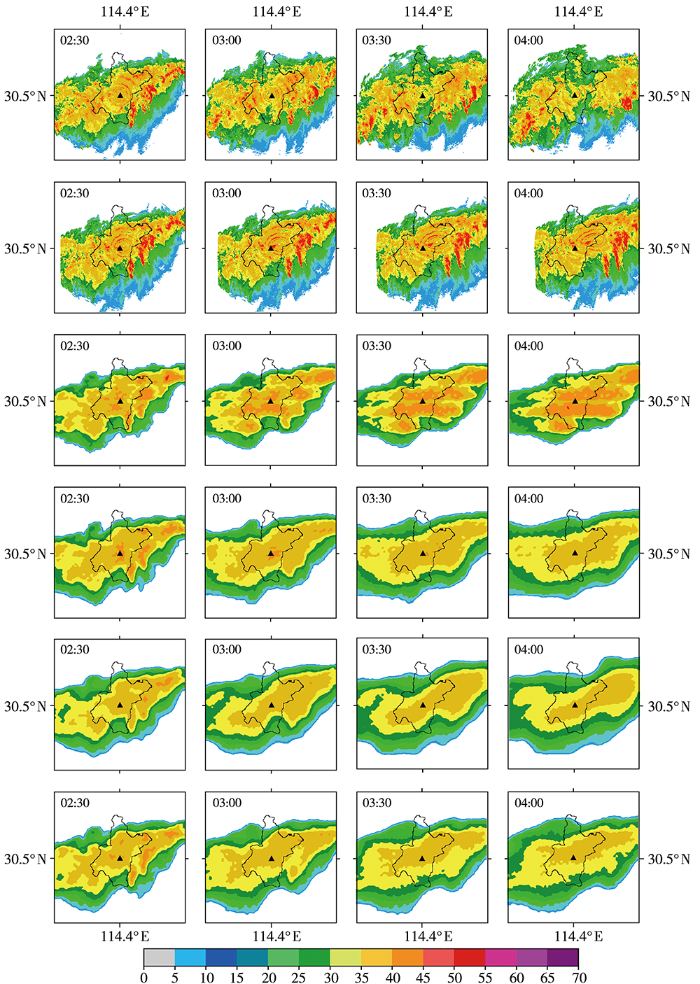

3.3.2 维持阶段

图3

图3

2021年8月24日02:30—04:00雷达回波实况和4种深度学习模型及光流法预报回波对比(单位:dBZ)

Fig.3

The comparison of radar echo forecasted by four deep learning models and optical flow method with the observation from 02:30 to 04:00 on 24 August 2021 (Unit: dBZ)

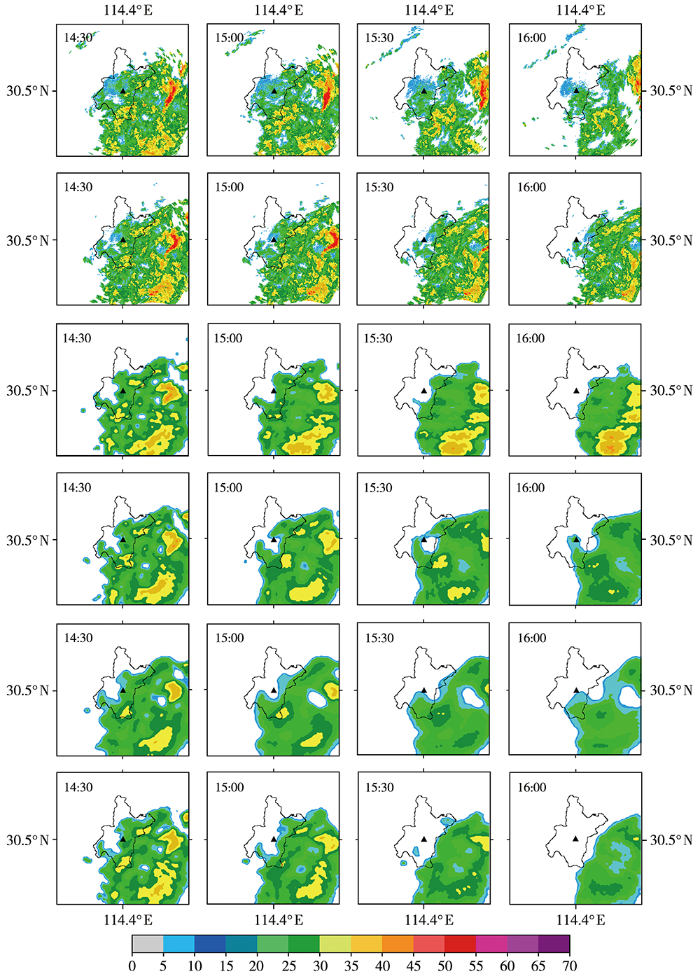

3.3.3 结束阶段

8月24日午后实况雷达回波显示,14:00武汉市东南部有强度约40 dBZ的片状回波,同时东部存在强度约45 dBZ的分散块状回波(图略);之后,东南部的片状回波和东部的块状回波均快速东移,且回波范围均明显减小、强度明显减弱;至16:00,东南部片状回波移出武汉市,而东部块状回波也移至东部边界(图4)。

图4

图4

2021年8月24日14:30—16:00雷达回波实况与4种深度学习模型及光流法预报回波对比(单位:dBZ)

Fig.4

Comparison of radar echo forecasted by four deep learning models and optical flow method with the observation from 14:30 to 16:00 on 24 August 2021 (Unit: dBZ)

对比各预报结果发现:光流法准确把握了武汉市东部和东南部回波东移趋势,但因“亮度恒定”基本假设,缺乏对回波强度变化的预报能力,而4种深度学习模型均准确把握了东部和东南部回波的移动规律及强度变化趋势,但MIN、PhyDNet和PredRNN++模型在预报的90~120 min回波强度减弱过快,而CrevNet模型则空报了东南部的片状回波,因而CrevNet模型的CSI最低,而其他3种模型CSI均高于光流法,相较光流法提升3.4%~10.2%。

4 结论与讨论

利用武汉地区2015—2020年雷达组合反射率因子和降水量资料,对PredRNN++、MIM、CrevNet和PhyDNet 4种深度学习模型进行临近预报训练,然后基于2021年汛期雷达组合反射率因子资料进行回波强度临近预报,并以MSE、SSIM、POD、FAR和CSI为检验指标,从预报时效、回波强度、降水强度等角度,详细评估了4种深度学习模型和光流法在2021年汛期武汉地区雷达回波的临近预报能力,得到如下主要结论:

(1)整体来看,4种深度学习模型中MIM的MSE最小、POD和CSI最高,CrevNet的MSE最大、POD和CSI最低;MIM和PredRNN++的SSIM并列最高。除CrevNet模型外,其余3种深度学习模型的CSI均高于光流法,提升幅度为2.2%~13.3%;所有深度学习模型的FAR均低于光流法,较光流法偏低8.6%~31.4%,其中PhyDNet模型的FAR最低。

(2)预报的前12 min,光流法的CSI最高,而预报的18~120 min,MIM模型的CSI最高。

(3)随着回波强度增加,各深度学习模型与光流法的CSI和POD都迅速降低,而光流法和深度学习模型的FAR却表现出不同的变化规律。

(4)对于区域性降水过程,随着降水强度增加,深度学习模型的预报能力先降低后明显增强,表明深度学习模型对强降水过程具有较好的预报能力,而光流法对降水强度变化的敏感性较弱,故对于强区域性降水过程深度学习模型(CrevNet除外)的CSI较光流法增幅最大,达10.0%~18.0%;对于局地一般对流性降水过程,所有深度学习模型的预报能力均大幅降低,POD和FAR均低于光流法。

(5)一次暴雨天气过程的检验结果显示:光流法由于“刚体边界”及对非线性运动拟合的缺陷,致使预报图像变形,且随着外推时间增长变形越明显,最终导致回波位置预报误差较大。此外,受亮度恒定假设的限制,光流法缺乏对回波强度变化的预报能力,而深度学习模型不仅对回波移动的把握能力强于光流法,还具备一定回波强度变化的预报能力,但预报的回波强度较实况明显偏弱。

虽然对于不同强度回波和不同强度降水过程,深度学习模型均表现出一定适应性,但也存在一些问题。首先,60 min之后深度学习模型预报的回波图像逐渐模糊,下一步拟利用不同降水强度的样本分别进行模型训练或引入生成对抗网络方法(陈元昭等,2019),提高模型对空间信息提取能力,最大程度地抑制预报图像的模糊问题。其次,深度学习模型的预报结果都具有一定的不确定性(偶然不确定性和认知不确定性两部分),通过增加高质量的训练样本数量和反复调整模型的超参数,可在最大程度上抑制模型的不确定性。再次,大多数雷暴的平均生命史仅30 min,对于生命史短于30 min的雷暴,外推预报的意义不大,而对于生命史较长的对流系统,外推预报才具有意义。最后,基于雷达回波的外推预报具有一定局限性,快速更新循环预报的高分辨率中尺度数值模式与不断发展的外推技术的融合将是未来临近预报的发展方向(王丹等,2014)。

参考文献

基于卷积门控循环单元神经网络的临近预报方法研究

[J].基于天气雷达资料的外推预报是灾害天气0~2 h临近预报基础, 本文以业务应用为目标, 应用广东省2015 -2018年11部新一代多普勒雷达反射率拼图资料, 研究了基于卷积门控循环单元神经网络ConvGRU的临近预报方法, 采用多损失函数加权与分级加权的策略, 基于ConvGRU框架建立三层自编码模型(Encoder-Decoder)的雷达回波临近预测模型, 进行未来2 h逐6 min、 连续20帧雷达回波图的预测, 并与业务上已经应用的交叉相关法、 光流法和粒子滤波法的临近预报结果对比, 进行典型个例分析和长时间检验。结果表明, 基于ConvGRU方法对强对流天气具有较好的预报效果, 对雷达回波位置、 强度和形状与实况更接近, 表明深度学习方法通过对时间序列数据的学习, 能较好地把握强回波区域的特征, 在一定程度上能够相对比较准确地预报较强回波范围, 但该方法预报雷达回波图像存在损失空间细节信息的局限, 且对层状云降水的预报效果较差; ConvGRU方法的临界成功指数(CSI)和命中率(POD)评分高于传统的交叉相关法、 光流法和粒子滤波法, 且虚警率(FAR)评分为最小, 在业务中具有广泛的应用前景。

基于雷达回波外推和中尺度模式预报的短时降水对比分析

[J].针对2011年夏季北京四次不同类型的降水过程,利用雷达临近预报算法MTREC和中尺度数值预报系统BJ-RUC对不同类型降水的短时预报能力进行了对比分析,并总结了两者的预报性能及特点。结果表明:(1)从降水预报偏差看,对于不同类型的降水预报,在研究的降水时段内,MTREC和BJ-RUC均表现为降水预报偏强。MTREC对四次降水过程的预报偏差较为平稳,而BJ-RUC随过程差异变化较大。(2)从降水预报落区看,MTREC的预报准确性随降水过程差异明显,降水系统范围越大,预报准确性越高。而BJ-RUC总体上表现平稳,对局地对流性降水的预报能力仍然有限。(3)从整体预报性能看,对于0~6 h降水预报,MTREC和BJ-RUC在预报性能上存在交叉点。交叉点的出现时间因降水过程而异,降水范围越大、组织性越强,交叉点出现越晚。

TITAN: Thunderstorm identification, tracking, analysis, and nowcasting—a radar-based methodology

[J].

Three-dimensional storm motion detection by conventional weather radar

[J].

Convolutional LSTM network: a machine learning approach for precipitation nowcasting

[C]//

Use of three-dimensional reflectivity structure for automated detection and removal of nonprecipitating echoes in radar data

[J].

Disentangling physical dynamics from unknown factor for unsupervised video prediction

[C]//

PredRNN++: towards a resolution of the deep-in-time dilemma in spatiotemporal predictive learning

[C]//

PredRNN: recurrent neural networks for predictive learning using spatiotemporal LSTMs

[C]//

Memory in memory: a predictive neural network for learning higher-order non-stationarity from spatiotemporal dynamics

[C]//

Image quality assessment: from error visibility to structural similarity

[J].Objective methods for assessing perceptual image quality traditionally attempted to quantify the visibility of errors (differences) between a distorted image and a reference image using a variety of known properties of the human visual system. Under the assumption that human visual perception is highly adapted for extracting structural information from a scene, we introduce an alternative complementary framework for quality assessment based on the degradation of structural information. As a specific example of this concept, we develop a Structural Similarity Index and demonstrate its promise through a set of intuitive examples, as well as comparison to both subjective ratings and state-of-the-art objective methods on a database of images compressed with JPEG and JPEG2000.

Efficient and information-preserving future frame prediction and beyond

[C]//